什么是AvatarGO?

AvatarGO是由南洋理工大学S-Lab、上海AI实验室和香港大学联合开发的新型AI框架,专注于从文本输入直接生成高质量的4D人体与物体交互场景。该框架采用了零样本(zero-shot)方法,基于预训练的扩散模型,解决了传统方法在生成日常人体-物体交互(HOI)场景时因数据不足而受限的难题。

AvatarGO的核心优势

-

LLM引导的接触重定位:通过Lang-SAM模型从文本提示中精准识别接触部位,如手、脚等,确保人体与物体的空间关系精确无误。

-

空间感知的运动优化:利用SMPL-X模型的线性混合蒙皮(LBS)函数构建运动场,优化人体和物体的动画,有效减少穿透问题。

-

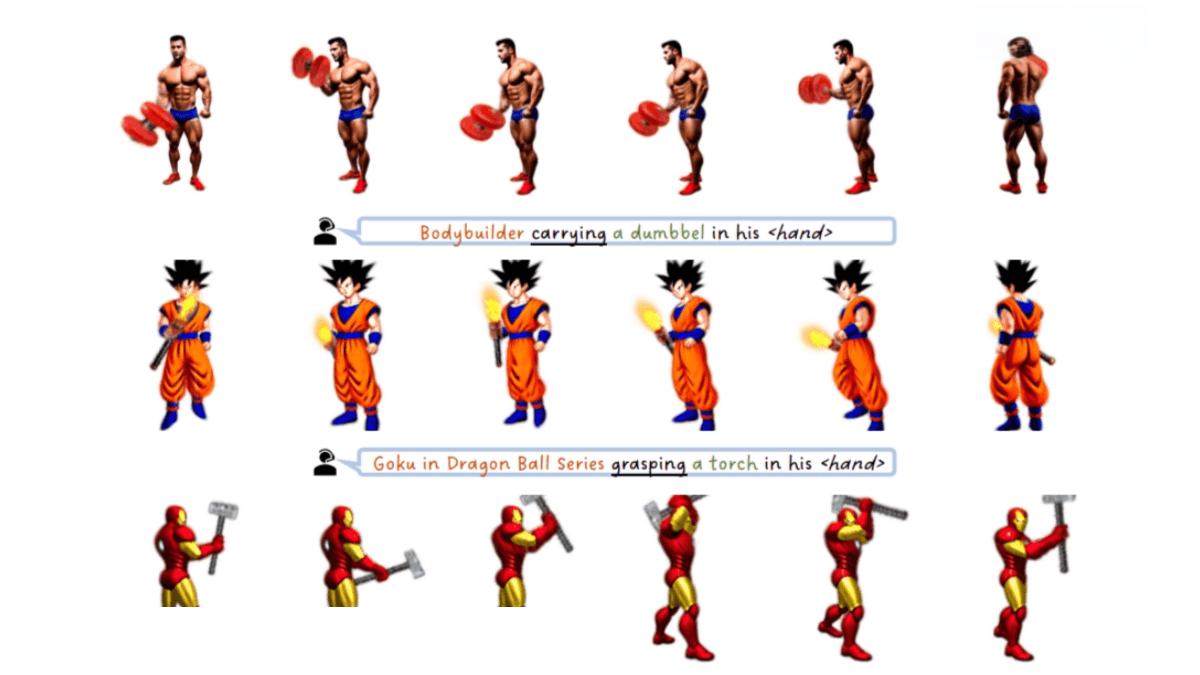

多样化的4D动画生成:支持多种人物动作和物体交互,涵盖虚拟角色(动漫人物、超级英雄)及现实人物,以及日常物品(武器、工具、乐器等)。

AvatarGO的技术原理

AvatarGO的技术实现基于多个创新模块,确保生成的4D动画既准确又逼真。1. LLM引导的接触重定位Lang-SAM模型从文本描述中提取关键接触部位,通过将3D人体模型渲染成2D图像,并结合文本提示生成接触部位的分割掩码。这些掩码被反向投影到3D模型中,精确初始化物体位置,确保接触部位的准确性。

2. 空间感知的分数蒸馏采样

AvatarGO引入空间感知分数蒸馏采样(SSDS),增强与人体-物体交互相关的文本标记(如“holding”)的注意力权重,帮助扩散模型更好地理解两者之间的空间关系。

3. 对应关系感知的运动优化

基于SMPL-X模型构建运动场,利用线性混合蒙皮(LBS)函数将物体运动与人体运动同步优化。引入对应关系感知损失,最小化人体与物体之间的空间偏差,确保动画过程中无穿透现象。4. 基于扩散模型的3D和4D生成

-

3D生成:采用DreamGaussian方法生成高质量的3D人体和物体模型,结合3D高斯点云表示场景,并通过分数蒸馏采样(SDS)优化结果。

-

4D动画生成:在3D模型基础上,利用HexPlane特征和SMPL-X模型生成动态4D动画,优化物体全局参数(如旋转、平移)和人体运动序列,确保动画连贯逼真。

AvatarGO的应用场景

AvatarGO的多功能性使其在多个领域具有广泛应用前景:

1. 虚拟导购员

在零售场景中,AvatarGO可生成虚拟导购员,为顾客提供商品信息和购物建议,提升购物体验。

2. 展厅讲解员

博物馆或展厅中,AvatarGO生成的讲解员可生动介绍展品,增强观众互动体验。

3. 数字大堂经理

银行或营业厅中,AvatarGO可作为数字大堂经理,提供咨询服务和引导服务,提升客户满意度。

4. 车载虚拟助手

在汽车领域,AvatarGO生成的虚拟助手可提供智能陪伴和交互体验,丰富驾驶乐趣。

5. VR/AR内容创作

AvatarGO在VR/AR领域具有重要价值,可用于生成高质量4D动画,助力虚拟现实和增强现实中的角色和交互设计。

AvatarGO的项目资源

总结

AvatarGO作为一款创新的4D人体与物体交互生成框架,凭借其零样本生成能力、精确的空间关系表示和多样化的应用场景,正在为AI工具领域注入新的活力。无论是学术研究、商业应用还是内容创作,AvatarGO都展现了强大的潜力。如果您对生成式AI技术感兴趣,不妨深入了解Avatar